Google Search Quality Evaluator Guidelines nous dit que la note la plus basse est attribuée quand l’ensemble du contenu principal d’une page est copié sans effort d’expertise, de recherche et n’offre aucune valeur ajoutée aux utilisateurs.

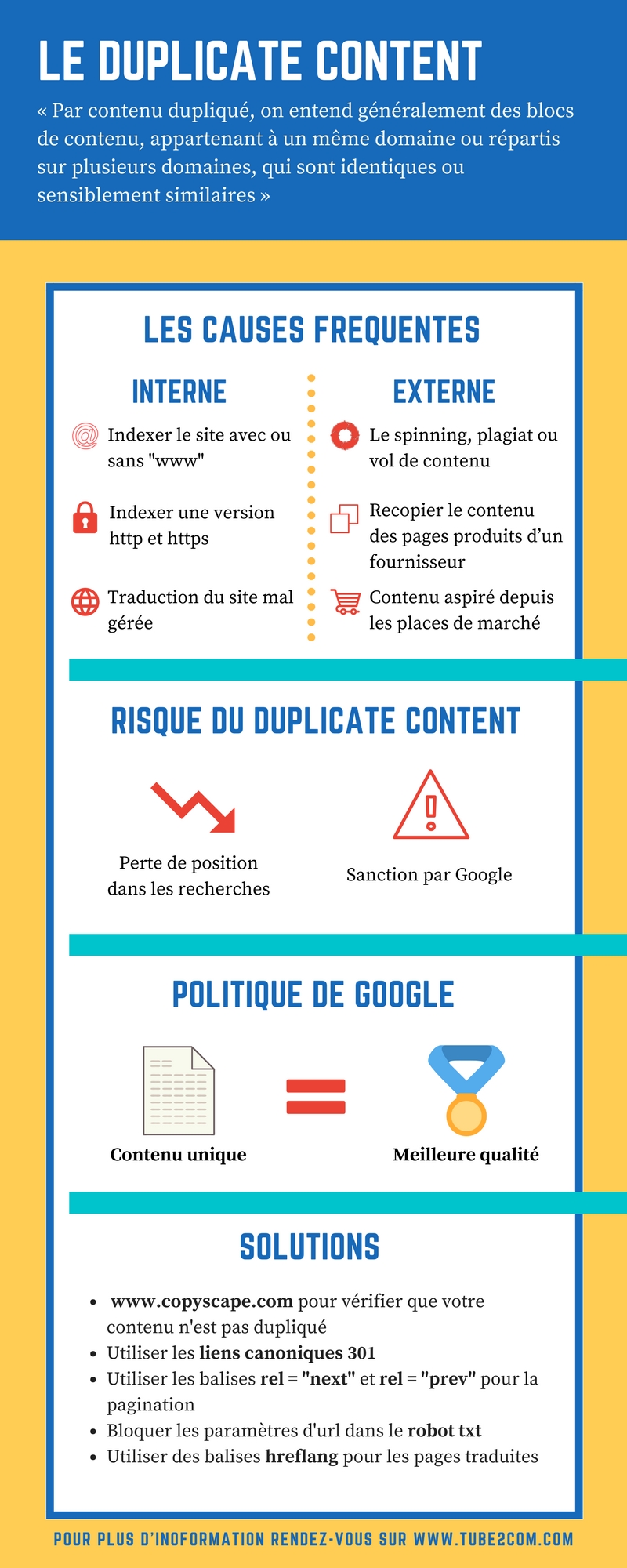

Le contenu dupliqué ou «duplicate content» est monnaie courante sur internet et la plupart du temps, sans intention malveillante. On parle de duplicate content quand deux contenus similaires ou presque identique sont présents sur deux pages web différentes.

Ci-dessous quelques points mis en avant pour vous aider à mieux comprendre le contenu dupliqué.

Sommaire :

- Ce qu’il faut savoir sur le duplicate content

- Questions et réponses de google sur le contenu dupliqué

- Les bonnes pratiques

- Ce qu’il faut retenir

- Ce qu’il faut savoir sur le duplicate content

Ce qu’il faut savoir sur le duplicate content

C’est quoi le contenu dupliqué ?

Voici la définition de Google :

Le contenu dupliqué fait référence à des blocs de contenu substantiel sur un site web ou à travers des noms de domaines avec du contenu très similaire.

Il faut différencier le contenu dupliqué interne de l’externe. Le contenu dupliqué interne représente des doublons présents au sein d’un même site. Cela peut être lié à un problème de configuration, à l’indexation ou au crawl des pages.

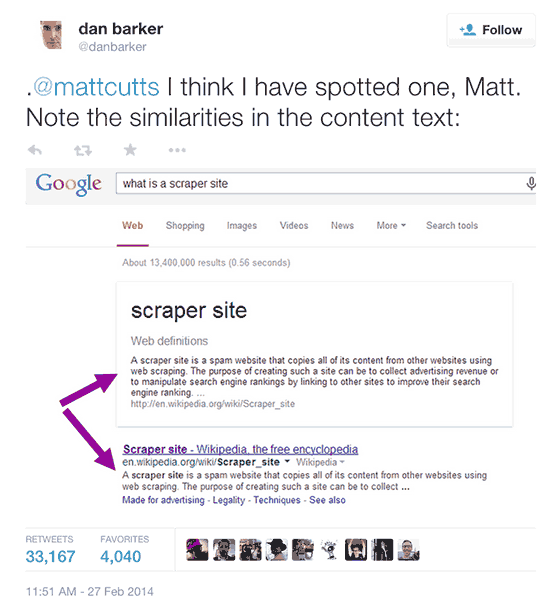

Alors que le contenu dupliqué externe est souvent du contenu copié-collé d’un site vers un autre. Il est plus difficile de gérer le contenu dupliqué externe lié au fait que vous n’avez pas forcément accès au site en question. De plus les moteurs de recherche ne sont pas toujours à la hauteur pour connaître l’auteur original. Les cas fréquent de contenu dupliqué externe sont fait entre les site e-commerce et les marketplaces (amazon, cdiscount …)

Il est important de comprendre que si en 2018, en tant que Webmaster, vous publiez des billets de blogues, communiqués de presse, des reportages ou descriptions de produits que vous avez trouvé sur « d’autres » sites, alors vos pages auront beaucoup de difficultés à être bien classés sur Google.

Google n’utilise pas le mot « pénalisé » mais si votre site en entier est fait de contenu dupliqué, vous avez peu de chances d’être bien positionné. Google fait place aux sites apportent de la valeur ajoutée.

Si vous avez mis en place une stratégie multi-site pour vendre les mêmes produits, vous allez certainement cannibaliser votre trafic sur le long terme plutôt que de dominer dans un domaine comme vous pouviez le faire auparavant. Avoir du contenu dupliqué sur un site peut le pénaliser.

Dans le pire des cas, votre site peut être affecté par l’algorithme Panda de Google.

Une bonne règle de base est ; de ne pas s’attendre à être bien placé dans les recherches avec du contenu trouvé sur d’autres sites plus fiables et de s’attendre à ne même pas apparaître dans les recherches si les contenus de votre site sont générés automatiquement sans «valeur ajoutée».

Google veut récompenser le contenu riche, unique, pertinent, informatif et remarquable dans les résultats organiques et la barre de qualité s’est beaucoup élevée au cours des dernières années.

Si vous voulez être bien placé sur Google pour des mots-clés ou phrases pertinents pour un bon bout de temps, il vaut mieux avoir beaucoup de contenu originale pour commencer.

C’est quoi le contenu ‘Boilerplate’?

Wikipédia décrit le contenu ‘boilerplate’ comme :

Le contenu boilerplate est tout texte qui peut être réutilisé dans de nouveaux contenus ou applications sans être grandement modifié comparé à l’original.

Et Google nous dit :

Limitez les répétitions.

Google cherche très probablement à voir si vos pages peuvent se distinguer des autres.

Comment fait il algorithmiquement ? Eh bien, il pourrait chercher à voir si des blocs de texte sur vos pages sont uniques, ou si les blocs de contenu sont très similaires à d’autres pages de votre site.

Si ce contenu «boilerplate» est le contenu PRIMAIRES de plusieurs pages, Google peut facilement filtrer, ignorer ou pénaliser cette pratique.

Une décision sensée serait d’écouter Google et minimiser ou au moins diminuer les instances de contenu boilerplate, page à page sur votre site Web.

Exemple : si un produit à 10 URL, une URL pour chaque couleur du produit, puis le titre, la méta description, la description du produit … pour ces pages supplémentaires elles vont probablement dépendre du contenu BOILERPLATE pour les créer, et en faisant cela, vous créer 10 URL sur le site qui ne dépendent essentiellement du contenu dupliqué de plusieurs pages.

Il est important que le texte de votre site soit unique, car utiliser du contenu dupliqué va probablement être contre-productif au lieu d’aider réellement votre site web

Si vous avez beaucoup de pages de contenu similaire sur votre site, Google pourrait avoir du mal à choisir la page que vous voulez classer, et il pourrait diluer votre capacité de référencement.

Par exemple, si vous avez un bouton «imprimer cette page» sur votre site. Attention a ce que Google n’indexe pas cette page en doublon de votre page web (Joomla avait de gros problèmes à ce sujet). Cela peut créer automatiquement des milliers de pages dupliquées juste a cause d’un mauvais paramétrage.

Cela va probablement avoir un impact sur les conversions et le «link building» par exemple. Des sites mobiles mal mis en place peuvent causer des problèmes du contenu dupliqué aussi.

Qu’est-ce que le contenu «Near-duplicate» (quasi dupliqué) ?

« Voyez cela comme un morceau de contenu qui a été légèrement modifié, ou si elle a été copiée le ‘boilerplate’ est différent. »

D’après notre expertise et nos recherche, il semblerait qu’une fois que Google détecte une page qui est un dupliquée ou quasi dupliquée d’une autre page, il va s’avérer difficile de classer cette page contre la source.

Quoi que vous fassiez, méfiez-vous des textes modifiés, Google pourrait avoir un algorithme mis en place pour ce genre de chose. Il est préférable de tester sur une petite partie de texte et voir comment Google prend le contenu dupliqué en considération.

Questions et réponses de Google sur le contenu dupliqué

Est-ce que le contenu dupliqué peut être classé sur Google ?

Oui. Il existe des stratégies qui fonctionnent toujours, à court terme.

Les opportunités sont réservées aux SERPs (résultats des recherches) locaux ou les dix premiers résultats sont déjà bourrés de résultats de faible qualité, et les SERPs sont en mauvais état, certainement pas une stratégie pour des mots-clés compétitifs.

Il n’y a pas énormément de trafic dans les résultats d’expressions clés (long tail), sauf si vous le faites en masse mais cela pourrait engendrer d’autres problèmes de qualité sur le site. Mais parfois, cela vaut la peine d’explorer cette optique si vous utilisez un contenu très similaire avec des indicateurs géographiques sur un site avec une certaine autorité de domaine.

Si les pages de faible qualité sont plus ou moins bien classés dans les dix premières place d’une recherche long traîne, elle valent la peine d’être exploré. Si elle améliore l’expérience de l’utilisateur et est meilleure que ce qui est déjà présent dans les résultats, personne ne va se plaindre.

Comment Google classifie du contenu comme dupliqués à travers plusieurs sites web ?

«… dans certains cas, le contenu est dupliqué délibérément entre les sites pour tenter de manipuler le classement sur les moteurs de recherche ou d’augmenter le trafic.

Les pratiques trompeuses comme celle-ci peuvent donner une mauvaise expérience aux utilisateurs. C’est le cas lorsqu’un visiteur voit sensiblement le même contenu répété dans un ensemble de résultats de ses recherches.

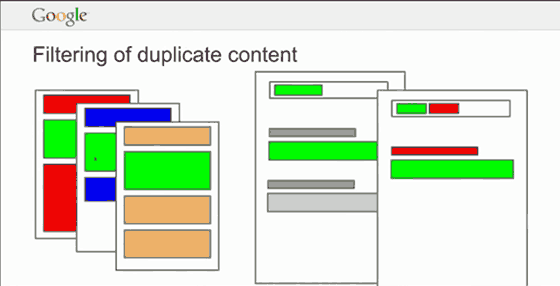

Google tente difficilement d’indexer des pages et d’afficher des informations uniques.

C’est le cas, si votre site a une version « web » et une version « imprimante » de chaque article, et aucun des deux est bloqué par une balise Meta noindex. Google va choisir arbitrairement la page a lister.

Dans les rares cas où le contenu que Google perçoit est dupliqué avec l’intention de manipuler les classements et de tromper les utilisateurs, des sanctions appropriés seront prises dans l’indexation et le classement des sites concernés.

En conséquence, le classement du site peut être affecté, ou le site peut même être retiré de l’index de Google, dans ce cas il ne paraîtra plus dans les résultats de recherche. » – GOOGLE

Si vous essayez de vous positionner sur des requêtes compétitives, vous avez besoin de contenu original qui est introuvable sur d’autres pages de votre site. Ceci est encore plus vrai quand ce contenu est présent sur des pages de sites externes.

Google n’est pas obligé de classer votre contenu plus haut que votre concurrent, cela dépend qui des deux a plus d’autorité de nom de domaine ou avec plus de liens qui pointent vers la page.

Historiquement ou du moins en 2018, il s’agit souvent de la page qui satisfait le plus les utilisateurs.

Si vous voulez éviter d’être filtrés par des algorithmes de contenu dupliqués, produisez du contenu unique.

Le contenu original est roi

Accrochez-vous au contenu original, se trouvant sur une seule page de votre site, pour de meilleurs résultats, surtout si vous avez un nouveau / jeune site web… et vous obtiendrez de meilleurs classements et plus de trafic sur votre site.

Dois-je empêcher Google d’indexer mon contenu dupliqué ?

Il n’y a pas de raison de bloquer du contenu dupliqué.

Il y avait une réponse sur les forums de Google il y a quelque temps de cela avec des conseils de Google qui dit comment gérer le contenu identique ou très similaire :

« Nous recommandons de ne pas bloquer l’accès au contenu dupliqué sur votre site, que ce soit avec un fichier robots.txt ou d’autres méthodes ».

Il y avait aussi quelques bons conseils sur la façon de gérer le contenu en double sur votre site :

- Prendre connaissance du contenu en double sur votre site web.

- Déterminez vos URL préférées.

- Soyez cohérent à travers votre site Web.

- Appliquer des redirections permanentes 301 là où c’est nécessaire et possible.

- Implémenter l’élément rel = « canonical » sur les pages ou vous pouvez.

- Utilisez l’outil de gestion des paramètres d’URL dans Google Webmaster Tools, si possible.

Google est très clair, ils ne veulent pas que nous bloquions nos contenus dupliqués, et cela se reflète dans les directives.

Google ne recommande pas de bloquer l’accès du robot vers le contenu dupliqué de votre site Web, que ce soit avec un fichier robots.txt ou d’autres méthodes.

Si les moteurs de recherche ne peuvent pas explorer des pages avec du contenu en double, ils ne peuvent pas détecter automatiquement que ces URL pointent vers le même contenu et va donc les traiter comme des pages distinctes et uniques.

Une meilleure solution est de permettre aux moteurs de recherche d’explorer ces URL, mais les marquer comme doublons en utilisant l’élément de liaison rel = « canonical », l’outil de manipulation de paramètre d’URL ou de redirection 301.

Dans les cas où le contenu dupliqué conduit Google à passer beaucoup de temps à explorer votre site, vous pouvez bien sûr ajuster le réglage de la vitesse d’exploration sur Webmaster Tools.

Google dit qu’il a besoin de détecter une intention de manipuler les résultats pour recourir à une pénalité, et vous devriez ne pas avoir de problèmes si votre intention est innocente. Cependant il est facile se faire prendre et de donner l’impression de faire quelque chose de douteux 😉

Y a-t-il une pénalité pour le contenu dupliqué sur un site Web ?

Google donne des directives très explicites en matière de gestion de contenu dupliqué.

« On n’a pas de pénalité pour le contenu dupliqué. On ne va pas rétrograder un site pour avoir beaucoup de contenu dupliqué ».

et

« Vous n’êtes pas pénalisés pour avoir ce genre de contenu dupliqué »

L’important c’est de fournir de la valeur aux utilisateurs sur vos pages. Il est compréhensible que Google ne soit pas obligé de classer votre contenu dupliqué.

Pour ce qui est des sites e-commerce il est dit :

« Variations de couleurs pour les pages produits – vous n’allez pas créer des pages séparées pour cela. Avec ce genre de page il est préférable d’avoir des pages fortes en contenu unique au lieu d’avoir des pages avec du contenu modifié pour plusieurs pages différentes.

Une page générique forte en contenu l’emporte sur des centaines de pages médiocres ».

Si quelques pages sont les mêmes, avec juste des variations de mots-clés, ça devrait être ok. Mais si vous en avez des millions de ces pages, Googlebot peut penser que vous construisez des pages satellites et cela peu être sanctionné.

En règle générale, Google identifiera les meilleures pages de votre site si vous avez une bonne architecture et du contenu unique.

Le conseil est d’éviter les problèmes de contenu en double si possible et cela devrait être juste une question de bon sens.

Google veut (et récompense) le contenu original. Si vous appliquez cela, c’est un excellent moyen de faire monter le SEO et de créer une meilleure expérience pour l’utilisateur du site web en même temps.

Google n’aime pas que des techniques soient utilisées pour manipuler ses résultats et le contenu dupliqué est pratique courante d’un grand nombre de sites spam.

« Le contenu dupliqué sur un site ne veut pas dire que des actions seront prises contre ce site, à moins que l’intention du contenu dupliqué soit de tromper et manipuler les résultats des moteurs de recherche. »

Plus votre site paraît être créé manuellement avec chaque page ayant du contenu diffèrent et ne ressemble pas entièrement à une autre page, plus Google favorisera votre site.

Il est préférable d’éviter les contenus répétitifs et inutiles sur son site, et quand 100% est générés automatiquement ou contenu syndiqué sur un site, Il faut demander à Google de ne pas l’indexer avec un noindex dans les balises méta ou XRobots ou robots.txt pour l’enlever complètement.

Est-ce que l’algorithme de Google Panda pénalise le contenu dupliqué ?

Une partie de l’algorithme Google Panda se concentre sur les pages « minces » et la proportion de contenu de bonne qualité et de faible qualité. Les commentaires des utilisateurs servent de filtre à Google pour les niveaux de satisfaction.

Google dit qu’il n’y a pas de pénalité pour le contenu dupliqué, mais si Google classe le contenu dupliqué en tant que contenu copié, contenu « mince » ou « boilerplate », vous pouvez très bien avoir un problème !

Google Panda ne pénalise pas un site pour le contenu dupliqué, mais il mesure le site et le contenu de qualité. Google Panda rétrograde un site s’il détermine que l’intention du site est de manipuler les algorithmes.

Google Panda :

« Mesure la qualité d’un site en regardant la grande majorité des pages. Mais l’essentiel nous permet de prendre la qualité de l’ensemble du site en compte. Google Panda est un ajustement. En gros, nous avons pensé que le site tente de jouer avec nos systèmes, et malheureusement, avec succès. Nous allons donc ajuster le classement. Nous allons pousser le site en arrière juste pour assurer que cela ne fonctionne plus. »

Les bonnes pratiques

Vérifier que votre contenu n’est pas dupliqué

Un moyen facile de trouver un contenu en double est d’utiliser Google.

Il suffit de prendre un morceau de contenu de votre site et le mettre entre guillemets et faire une recherche sur Google.

Google vous dira combien de pages avec ce morceau de contenu il a trouvé dans les pages de son indexation.

L’outil le plus connu pour la vérification de contenu dupliqué en ligne est Copyscape.

Si vous trouvez des preuves de plagiat, vous pouvez déposer une DMCA ou contacter Google.

Comprendre si votre CMS produit du contenu dupliqué ou des pages minces

Google nous dit :

« Comprendre votre système de gestion de contenu : Assurez-vous que vous êtes familier avec la façon dont le contenu est affiché sur votre site. Les blogs, des forums et d’autres systèmes montrent souvent le même contenu dans plusieurs formats. Par exemple, une entrée de blog peut apparaître sur la page d’accueil d’un blog, dans une page d’archives, et dans une page d’autres entrées avec la même étiquette. »

WordPress, Magento, Joomla, Drupal ; produisent chacuns des pages de contenu dupliqué qui deviennent des défis à résoudre pour les webmaster.

Utiliser correctement les éléments des liens canoniques

Google recommande d’utiliser les éléments canoniques des liens pour minimiser le problème de contenu dupliqué. C’est un des outils le plus puissant mis à notre disposition.

Si votre site contient plusieurs pages avec du contenu en grande partie identique, il y a un certain nombre de façons pour indiquer votre URL prioritaire à Google. Ceci fait référence à la canonicalisation.

Matt Cutts de Google a partagé des conseils sur la balise rel = « canonical » (liens canonique) que les 3 moteurs de recherche prennent en considération maintenant. Google, Yahoo ! et Bing ont tous accepté de travailler ensemble dans un effort commun pour réduire le contenu dupliqué sur les gros sites complexes et le résultat c’est la nouvelle balise canonique.

Astuce – Redirigez vos vieux contenus vers les nouveaux contenus sur le même thème. Ce qui vous permettra de réduire les pages de mauvaises qualités ainsi que d’augmenter la qualité des pages que vous voulez classer sur Google.

Conseils de Google

Comme toutes les choses que fait Google, Google a ses propres critiques au sujet du contenu dupliqué :

Il y a quelques mesures que vous pouvez prendre pour résoudre de manière proactive les problèmes de contenu en double, et faire en sorte que les visiteurs voient seulement le contenu que vous voulez :

« Utilisez les 301 : Si vous avez restructuré votre site, utilisez des redirections 301 (redirections permanente) dans votre fichier. htaccess pour rediriger intelligemment les utilisateurs, Googlebot et autres moteurs.»

Vous devez également vous assurer que vos liens sont tous égaux, et éviter les variations de majuscule et minuscules sue la même URL.

Ce type de duplication peut être réglé rapidement en gardant des liens internes cohérents et l’utilisation de la balise canonique.

Google indique également aux Webmasters de choisir un nom de domaine favorable pour se classer.

« Utilisez les outils Webmaster Tools pour nous dire comment vous préférez que votre site soit indexé : Vous pouvez indiquer à Google votre domaine préféré (par exemple, http ://www.exemple.com ou http ://exemple.com). »

…vous devez vous assurer de gérer les redirections côté serveur, avec des redirections 301 pour rediriger toutes les versions d’une URL à une URL canonique (avec un élément de liaison canonique auto référencé).

« Limitez les répétitions : Par exemple, au lieu d’inclure un copyright au bas de chaque page, ajoutez plutôt un résumé et un lien vers une page avec plus de détails. En outre, vous pouvez utiliser l’outil de gestion des paramètres pour spécifier comment vous souhaitez que Google traite les paramètres d’URL.»

Utiliser les balises Rel = Next et Rel = Previous correctement

Les pages avec pagination ne sont pas du contenu dupliqué, mais il est souvent plus bénéfique pour l’utilisateur d’atterrir sur la première page de la requête.

Si vous pensez que vous avez des problèmes de contenu avec pagination sur votre site, ce n’est pas si compliqué de les traiter :

Google sait que la « pagination des sites web se fait différemment » selon la typologie des sites. Il existe plusieurs formes de contenus paginés :

- Sites d’information et/ou d’édition divisent souvent un long article en plusieurs pages plus courtes.

- Les sites de vente au détail peuvent diviser la liste des éléments dans une grande catégorie de produits en plusieurs pages.

- Les forums de discussion cassent souvent les discussions en URL séquentielles. »

Une bonne recommandation est de :

« Spécifiez une balise ‘afficher toutes les pages’. Les internautes préfèrent généralement pouvoir tout voir d’un article ou d’une catégorie sur une seule page. Par conséquent, si nous pensons que c’est ce que l’internautes est en train de rechercher, nous essayons de lui montrer ‘tout voir’ dans les résultats de sa recherche. Vous pouvez également ajouter un lien rel = « canonical » pour les pages de composants pour indiquer à Google que la version ‘tout voir’ est la version que vous souhaitez faire apparaître dans les résultats de recherche Google. »

Et

« Utilisez les liens rel = « next »et des rel = « prev » pour indiquer la relation entre les composants des URLs. Ce balisage fournit un signal fort à Google, que ces pages soient traitées comme une suite logique”.

Vous pouvez aussi utiliser des métas robots «noindex, follow» sur certains types de contenu paginé. Cependant, je vous recommande de réfléchir à deux fois avant de retirer définitivement ce contenu de l’index de Google. Il se peut que ces URL (ou une partie de ces URL) génèrent une bonne quantité de trafic.

Ce qu’il faut retenir

- Le contenu dupliqué n’est pas pénalisé.

- Google récompense le contenu unique et les pages avec des valeurs ajoutées.

- Google filtre le contenu dupliqué.

- Le contenu dupliqué ralentit Google dans la recherche de nouveaux contenus.

- Les sitemaps XML sont la meilleure méthode pour aider Google à découvrir votre nouveau contenu.

- Le contenu dupliqué ne va pas booster votre marketing.

- Google veut que vous vous concentriez sur les signaux des documents canoniques et il veut que vos efforts soient concentrés à rendre les pages canoniques mieux pour les utilisateurs.

- Pour le référencement, ce n’est pas nécessairement le contenu dupliqué en abondance qui est le gros problème. C’est un manque de signaux positifs, s’il n’y a pas de contenu unique ou valeur ajoutée votre site ne va pas mieux se positionner sur Google.

Plus de bonnes pratiques SEO :

- Les leviers du marketing digital : Le guide 2017-2018

- Google pénalise le texte caché par CSS

- Checklist passage HTTPS

- Checklist refonte SEO